Aksiyon figürü akımı sosyal medyayı sardı! ‘Masum gibi duruyor ama çok tehlikeli’ | İşte dikkat edilmesi gereken 5 kritik nokta

Son günlerde toplumsal medyada süratle yayılan ‘Barbie ambalajı’ usulündeki aksiyon figürü yapay zeka görselleri, dijital estetiğin geldiği noktayı gözler önüne seriyor. Ünlülerden, ferdi kullanıcılara kadar herkes bu akıma kapılmış durumda. Fakat bu renkli ve eğlenceli imgelerin art planında önemli bir güvenlik sorunu yatıyor.

Şu an bu üslup içerikleri üretmekte başı çeken uygulamalar ortasında Remini, Lensa AI, Picsart AI ve Photoleap üzere taşınabilir tabanlı yapay zeka dayanaklı görsel editörler var. Kimileri yüzü daha gerçekçi işlerken, kimileri estetik filtreler ve sahne efektleri konusunda daha başarılı.

Aynı hizmeti sunuyor üzere görünseler de kullandıkları aksiyon figürü yapay zeka modelleri, bilgi sürece siyasetleri ve fiyatlı içerik stratejileri önemli farklılıklar gösterebiliyor. Yani kullanıcı tecrübesi ve güvenlik açısından hepsi birebir değil.

Peki, bu uygulamaları bu kadar cazip kılan ne? Bilgilerimiz bu sistemlerde ne kadar inançta? Estetik bir trend üzere görünen bu durum aslında dijital dünyada daha büyük bir dönüşümün işareti olabilir mi?

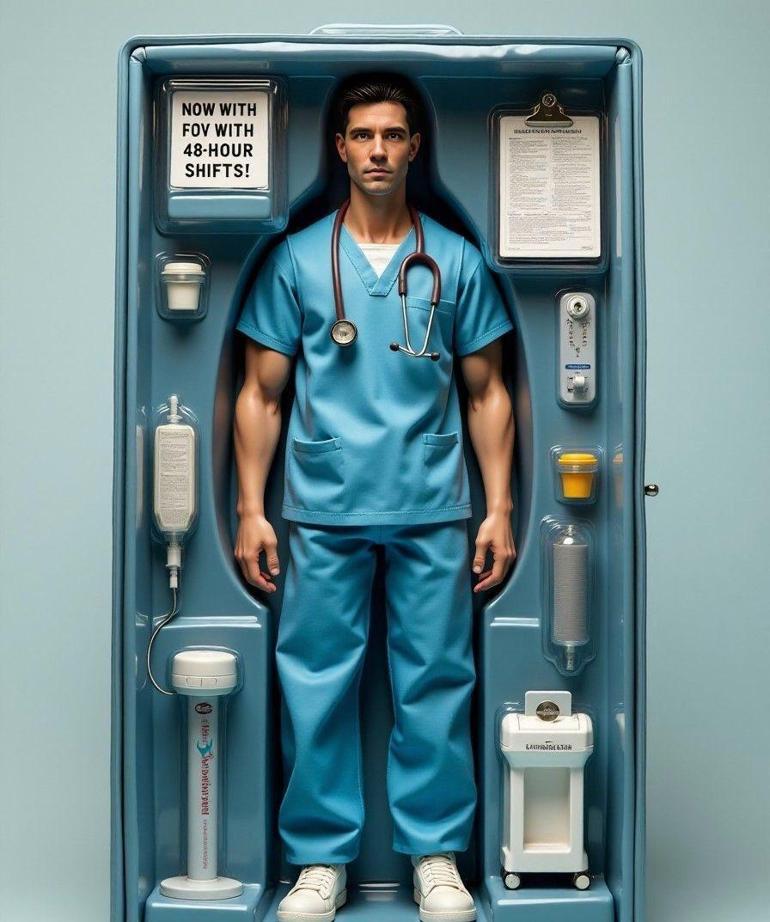

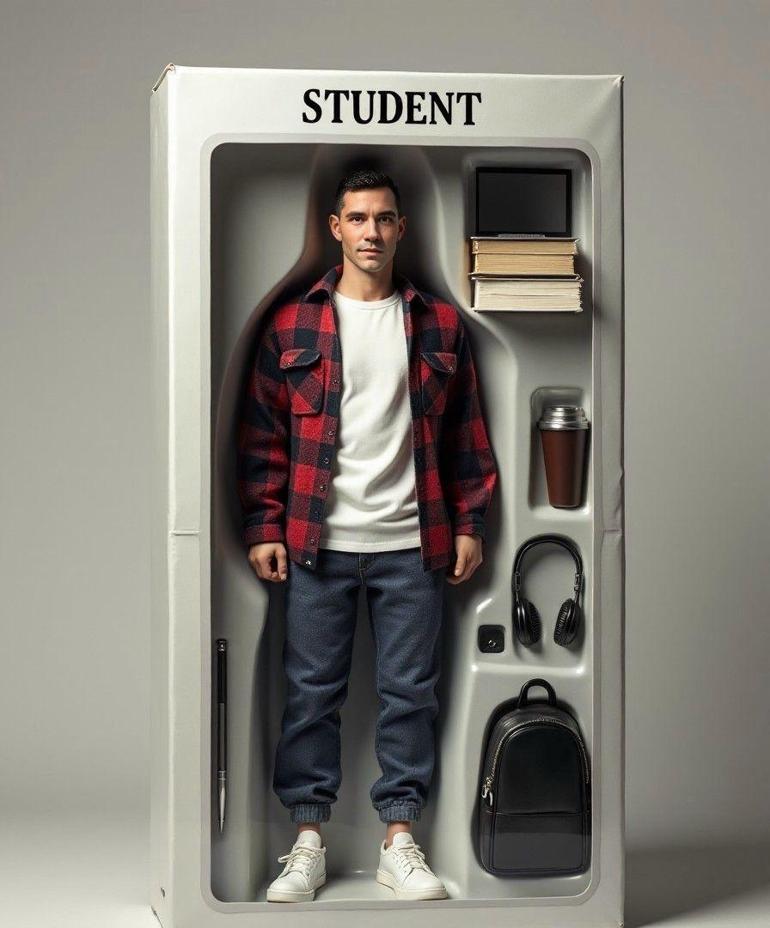

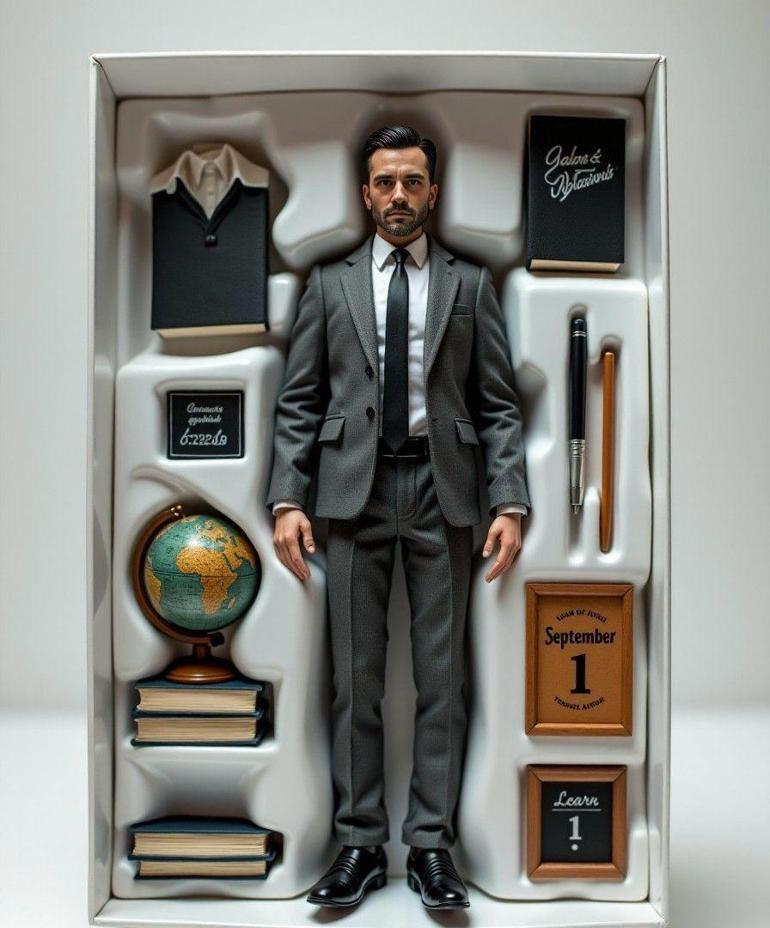

Prof. Dr. Ali Murat Kırık tarafından, kişinin de yapay zekâ aracılığıyla oluşturulduğu çalışmalar

BU GÖRSELLERİ OLUŞTURMAK İÇİN NE ÇEŞİT BİLGİLER İSTENİYOR?

Marmara Üniversitesi İletişim Fakültesi Görsel Bağlantı Tasarımı Anabilim Dalı Başkanı ve Bilişim Teknolojileri Uzmanı Prof. Dr. Ali Murat Kırık, “Genelde uygulamalar yüz fotoğrafı, yaş, cinsiyet, bazen de estetik tercihler üzere ferdî datalar talep ediyor. Bu datalar, görseli işleyip ‘kişiselleştirilmiş’ bir sonuç üretmek için kullanılıyor” dedi.

‘BİLGİLER SİLİNİYOR ÜZERE GÖZÜKÜYOR ANCAK BULUT SİSTEMLERDE SAKLANIYOR’

“Ancak bu bilgiler birçok vakit bulut sistemlerde saklanıyor ve dataların nerede, ne kadar mühlet tutulduğu şeffaf değil” diyen Prof. Dr. Ali Murat Kırık, “Bazı uygulamalar bilgiyi işler işlemez siliyor üzere görünse de aslında kullanım şartlarına gizlenmiş uzun vadeli saklama müsaadeleriyle verileri ellerinde tutabiliyorlar” sözlerini kullandı.

Siber güvenlik şirketi Parameter Security’nin CEO’su Dave Chronister, HuffPost’a yaptığı açıklamada, “Hayatınızda en çok kıymet verdiğiniz üç ya da dört şeyi açıkça paylaşmak büyük bir risk oluşturur. Zira bu cins bilgiler, sizi gaye almak isteyen bireyler için bedelli bir kaynaktır” dedi.

BU BİÇİM BİLGİLER BİRİNCİ BAKIŞTA GÜNAHSIZ ÜZERE DURUYOR AMA…

Bu uygulamalar üzerinden bilgi paylaşımının siber ataklar ya da dolandırıcılık için risk oluşturduğunun altını çizen Prof. Dr. Ali Murat Kırık, “Yüz verisi, biyometrik bir bilgi olduğu için en hassas bilgilerden biri. Yüzünüzden oluşturulan bir yapay zeka portresi, kimlik doğrulama sistemlerinde kullanılabilecek uydurma kimlikler üretmekte kullanılabilir. Ayrıyeten yapay zeka dayanaklı ses ve görüntü üretimiyle birleştirildiğinde deepfake dolandırıcılıklarına yer hazırlar. Bilhassa toplumsal medyada bu görselleri paylaşmak, makûs niyetli bireyler için bir data havuzu oluşturuyor” ihtarında bulundu.

MAĞDUR OLAN BEŞERLER VAR MI?

“Örneğin Çin’de yüz tanıma sistemleriyle banka hesabı açmak üzere süreçler yaygınlaştıkça, toplumsal medyada paylaşılan yüz görselleriyle kimlik sahtekarlıkları yaşandı” diyen Prof. Dr. Ali Murat Kırık, “Hindistan’da ise bir kullanıcı, yüzünü bir avatar uygulamasına yükledikten sonra kendi imgesinin müstehcen içeriklerde kullanıldığını fark etti. Türkiye’de de dolandırıcılık şikayetlerinde yapay zeka üretimi geçersiz profil fotoğraflarının kullanıldığı olaylar artıyor” dedi.

BU İÇERİKLER ASKERİ YA DA KURUMSAL YAPAY ZEKA EĞİTİMİNDE KULLANILABİLİR Mİ?

Stanford Üniversitesi İnsan Merkezli Yapay Zeka Enstitüsü’nden saklılık uzmanı Jennifer King ise, bu görsellerin gelecekteki yapay zeka modellerinin eğitilmesinde kullanılabileceğini ve bu teknolojilerin giderek daha fazla kurumsal ve askeri alanlara entegre edildiğini hatırlattı. Bu ne kadar gerçekçi?

Bu soruma “Bu ihtar hiç de uzak bir ihtimal değil” yanıtını veren Prof. Dr. Ali Murat Kırık, şu bilgilerin altını çizdi:

“Yapay zeka sistemleri, ne kadar çok ve çeşitli datayla eğitilirse o kadar güçleniyor. Kullanıcılar uygulamalara müsaade verirken, bilgilerinin üçüncü taraflarla paylaşılabileceğine dair hususlara onay veriyorlar ancak birden fazla vakit bunu fark etmiyorlar. Bu görseller daha sonra algoritmaların eğitilmesinde, yüz tanıma teknolojilerinde, hatta güvenlik ve izleme sistemlerinde kullanılabilir. Aslında beşerler fark etmeden data setlerine katkı sağlıyor.”

NELERE DİKKAT EDİLMELİ?

Çoğu kullanıcının kapalılık siyasetlerini okumadan bu uygulamaları kullandığını söyleyen Prof. Dr. Ali Murat Kırık, 5 kritik noktaya dikkat çekti:

“Yapılması gereken birinci şey, uygulamanın bilgileri nerede ve ne kadar müddet sakladığına bakmak. Üçüncü taraflarla paylaşım yapıp yapmadığını öğrenmek. Yüksek çözünürlüklü yüz görselleri yerine düşük kaliteli ya da filtreli görseller kullanmak, uygulamalara erişim müsaadelerini sınırlamak ve mümkünse telefon galerinize erişim müsaadesi vermemek” dedi.

BU ALANDA YASAL DÜZENLEMELER VAR MI, YOKSA HUKUK BU TEKNOLOJİLERİN GERİSİNDE Mİ KALIYOR?

“Maalesef birçok ülke, bu teknolojilerin gelişim hızına yetişemiyor. Avrupa Birliği, Dijital Hizmetler Yasası ve Yapay Zeka Yasası üzere adımlar atsa da birden fazla ülkede yüz verisiyle çalışan uygulamalara özel düzenlemeler hâlâ yetersiz” diyen Prof. Dr. Ali Murat Kırık, “Türkiye’de de KVKK birtakım temel haklar sağlasa da, taşınabilir uygulamalara has ayrıntılı bir kontrol düzeneği yok. Önümüzdeki yıllarda, bilhassa biyometrik data güvenliği konusunda daha sıkı ve milletlerarası uyumlu kanunların gelmesi kaçınılmaz üzere görünüyor” biçiminde konuştu.

Bazı uzmanlar ise kullanıcıları, figürlerinde ticari markalara ilişkin logoları kullanırken dikkatli olmaları konusunda uyardı. Avukat Charles Gallagher, Fox13’e yaptığı açıklamada, “Mattel üzere şirketler, markalarını müdafaa konusunda epeyce etkin. Aksiyon figürünüzde bir Barbie logosu kullanmanız tüzel sıkıntılara yol açabilir” dedi.